Melhoria com IA

Funcionalidade Opcional - Pode Ignorar!

Este passo é completamente opcional. O Vox funciona perfeitamente sem a Melhoria com IA - as suas transcrições já serão precisas. Configure apenas se quiser polir automaticamente as suas transcrições (corrigir gramática, remover palavras de preenchimento como "hmm" ou "é").

Se não tem a certeza do que é isto ou não quer configurar agora, fique à vontade para passar à próxima secção!

A Melhoria com IA usa inteligência artificial (como o ChatGPT ou o Claude) para limpar automaticamente as suas transcrições, tornando-as mais polidas e profissionais.

O que Faz a Melhoria com IA?

Em termos simples: Pega na sua transcrição (que já é precisa) e torna-a mais profissional.

Exemplo:

- Antes da IA: "Hmm, então basicamente, tipo, precisamos de, é, marcar uma reunião para, sabe, terça-feira"

- Depois da IA: "Precisamos de marcar uma reunião para terça-feira"

Principais Benefícios

- Corrige gramática: Corrige erros automaticamente

- Remove palavras de preenchimento: Elimina "hmm", "é", "tipo", etc.

- Torna o texto mais limpo: Mais profissional e fácil de ler

- Mantém o significado: A sua mensagem original permanece a mesma

Precisa Disto?

Pode querer a Melhoria com IA se:

- Usa o Vox para documentos ou e-mails profissionais

- Quer transcrições polidas sem editar

- Tem familiaridade com serviços de IA (como o ChatGPT)

NÃO precisa da Melhoria com IA se:

- Está apenas a tirar notas rápidas para si próprio

- Prefere privacidade total (a Melhoria com IA envia texto para serviços externos)

- Não se importa de editar transcrições manualmente

- Não sabe o que é uma "chave de API"

Nota de Privacidade

O seu áudio nunca sai do seu dispositivo. Apenas a transcrição de texto é enviada para o serviço de IA que escolher. Se quiser privacidade total, deixe a Melhoria com IA desativada.

Como Configurar

Requisitos

Para usar a Melhoria com IA, precisa de:

- Uma conta com um serviço de IA (como OpenAI, Anthropic, AWS, etc.)

- Uma chave de API (pense nela como uma senha para o serviço de IA)

- Alguns euros para custos de IA (geralmente €0,01-0,05 por transcrição)

Em Breve: Estamos a trabalhar numa opção paga integrada para que não tenha de configurar isto sozinho.

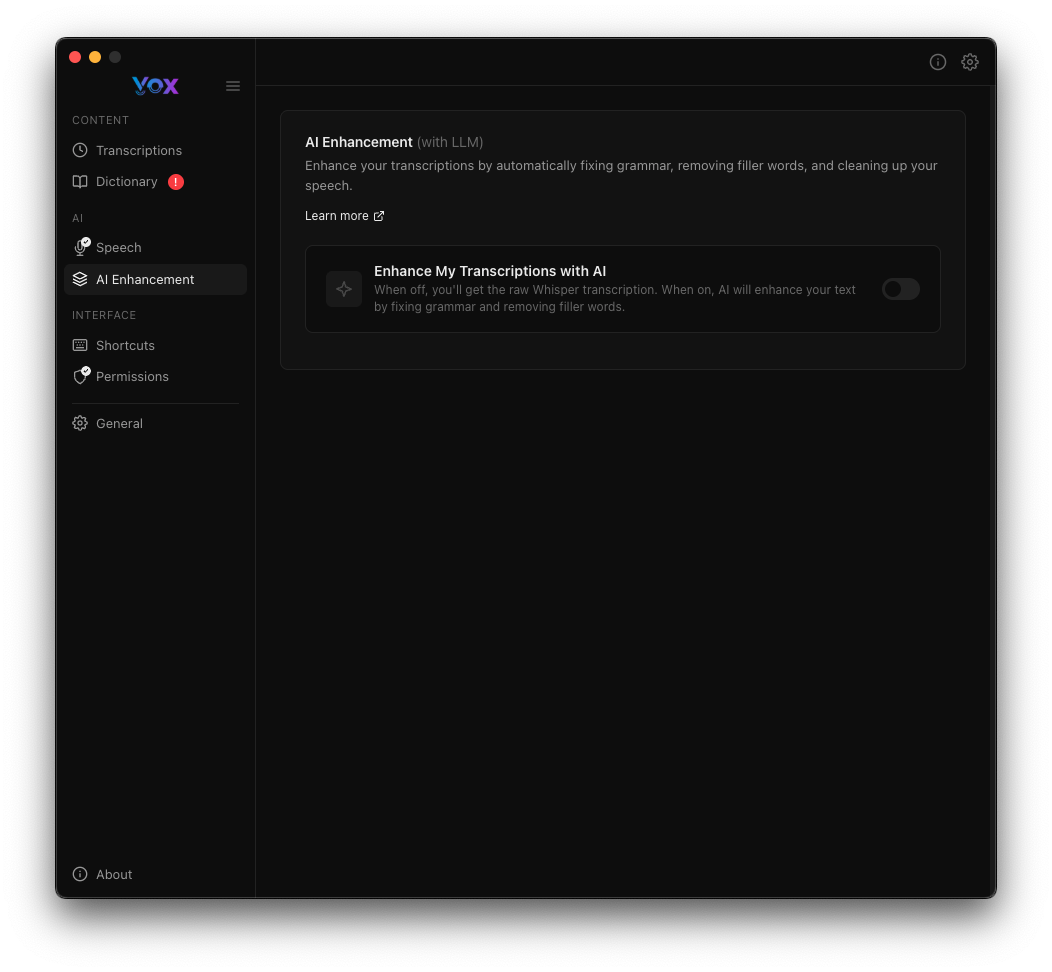

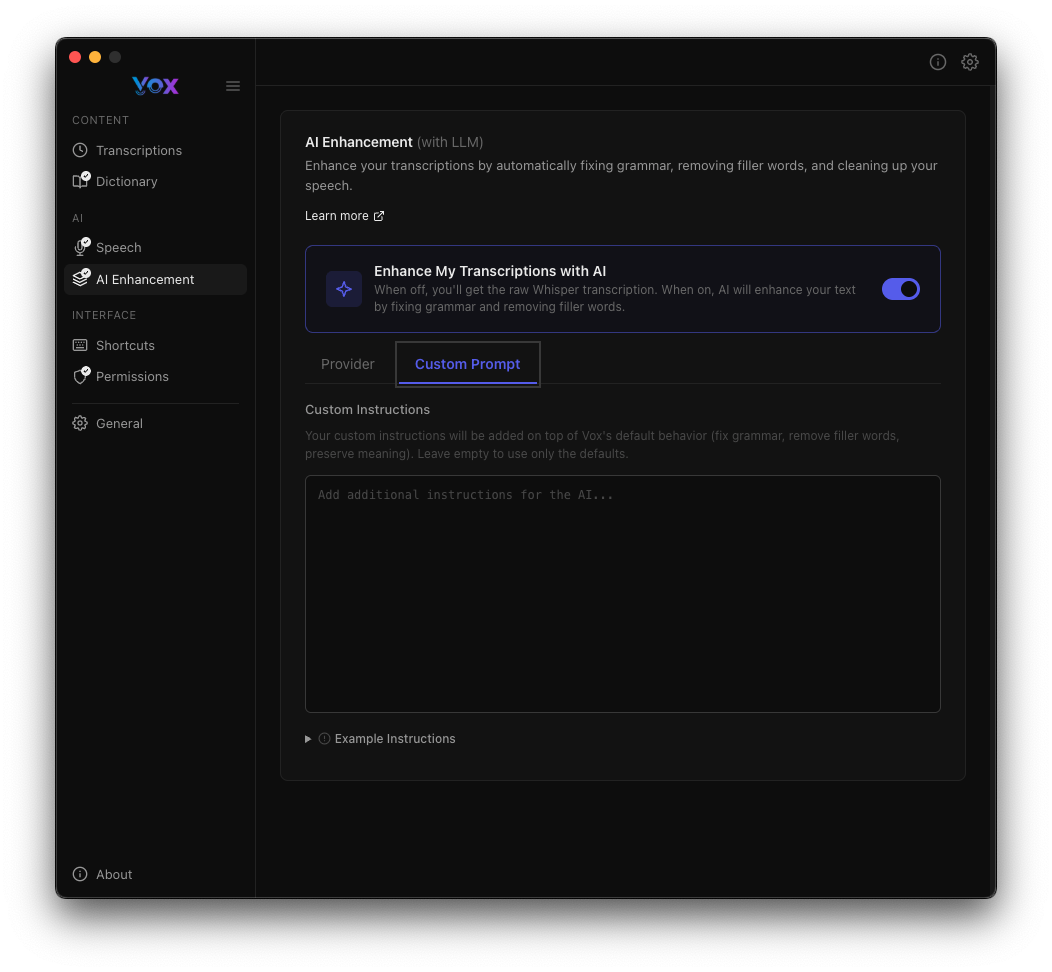

Passo 1: Abrir as Configurações de Melhoria com IA

- Abra as configurações do Vox

- Clique em Melhoria com IA na barra lateral

- Ative Melhorar as Minhas Transcrições com IA

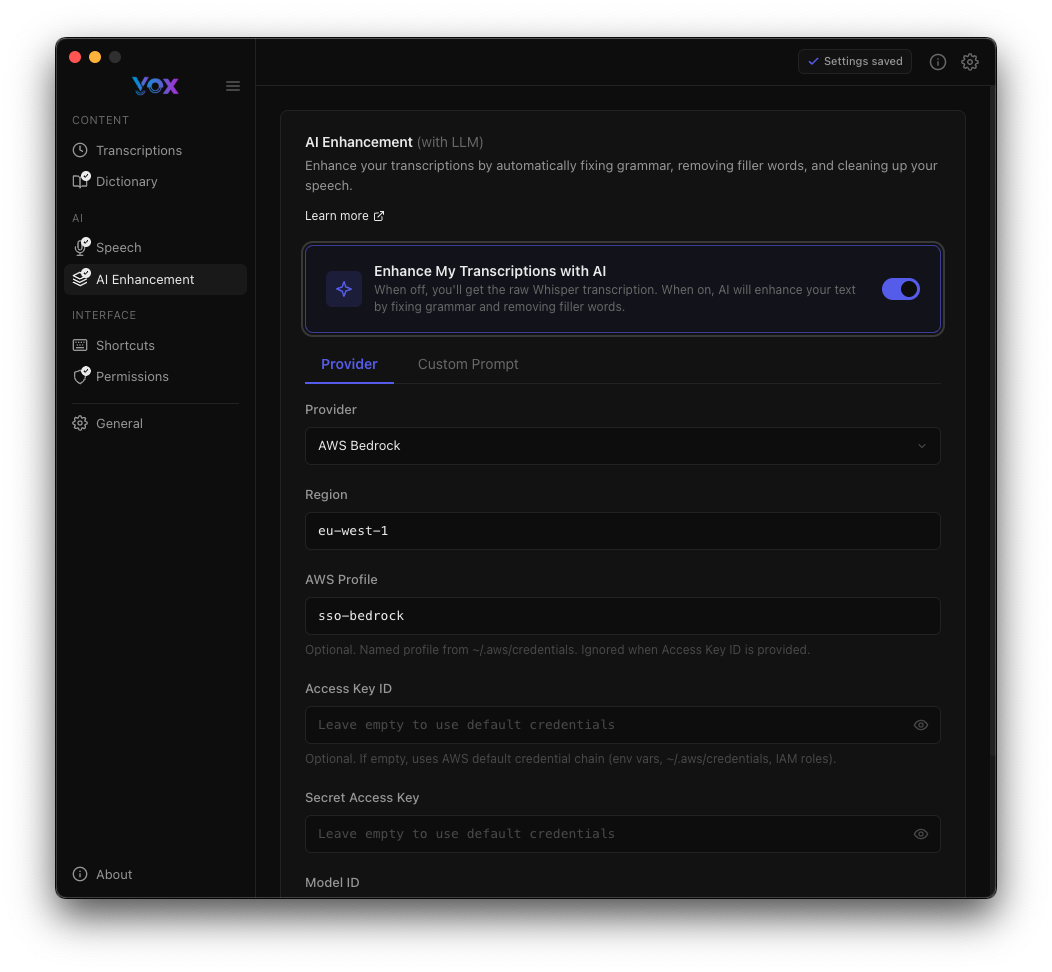

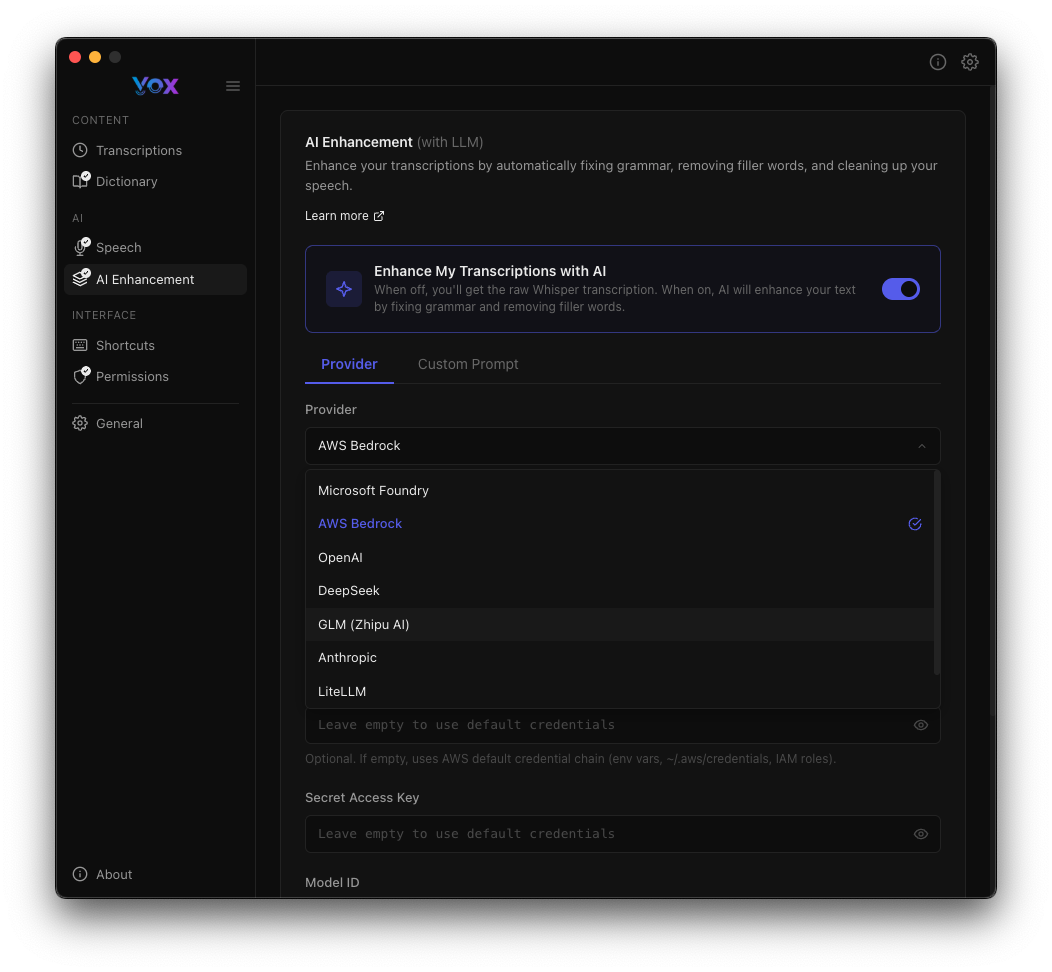

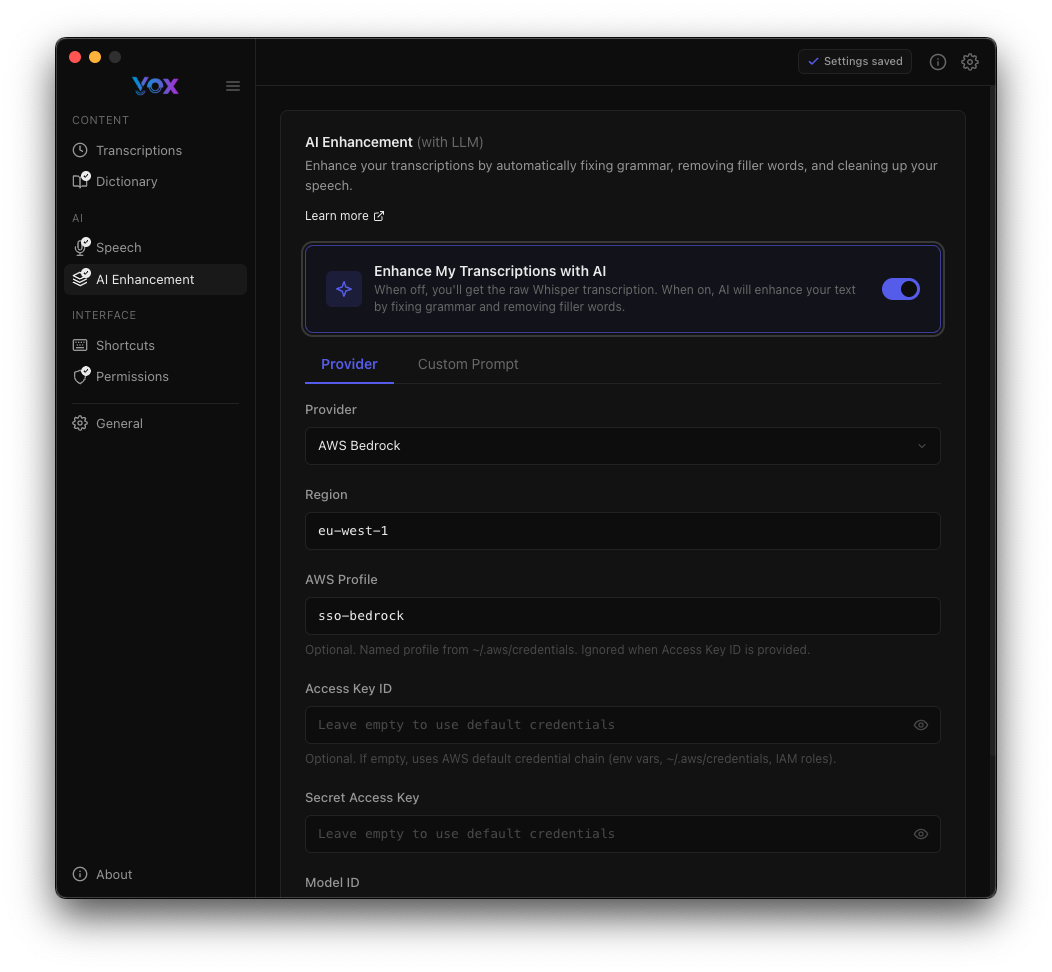

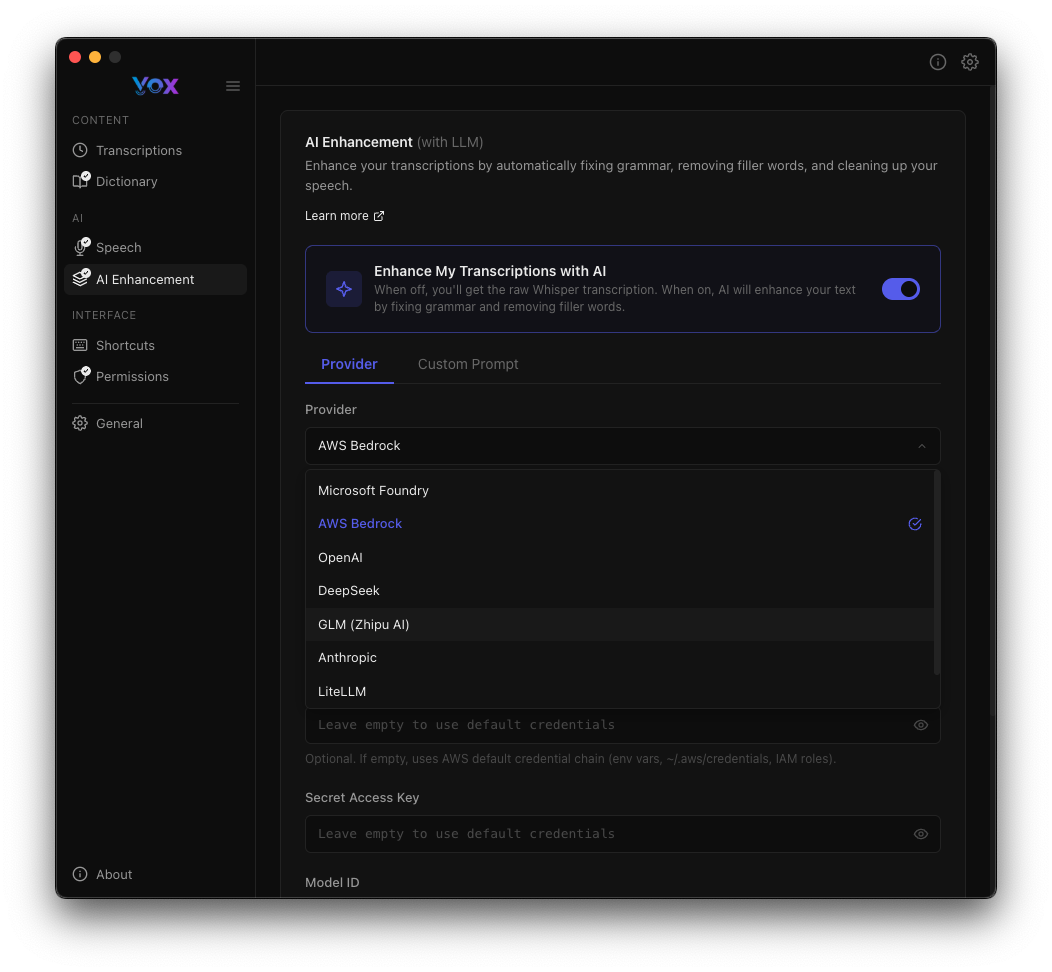

Passo 2: Escolher o Seu Fornecedor de IA

Selecione um serviço de IA no menu suspenso. Opções populares:

- OpenAI (ChatGPT) - Mais popular, fácil de usar

- Anthropic (Claude) - Boa qualidade, focado em privacidade

- AWS Bedrock - Para utilizadores avançados

- Ollama - Execute IA localmente (gratuito, mas requer configuração)

Passo 3: Adicionar a Sua Chave de API

- Obtenha uma chave de API do seu fornecedor escolhido (veja as secções de fornecedores abaixo)

- Cole-a no campo Chave de API

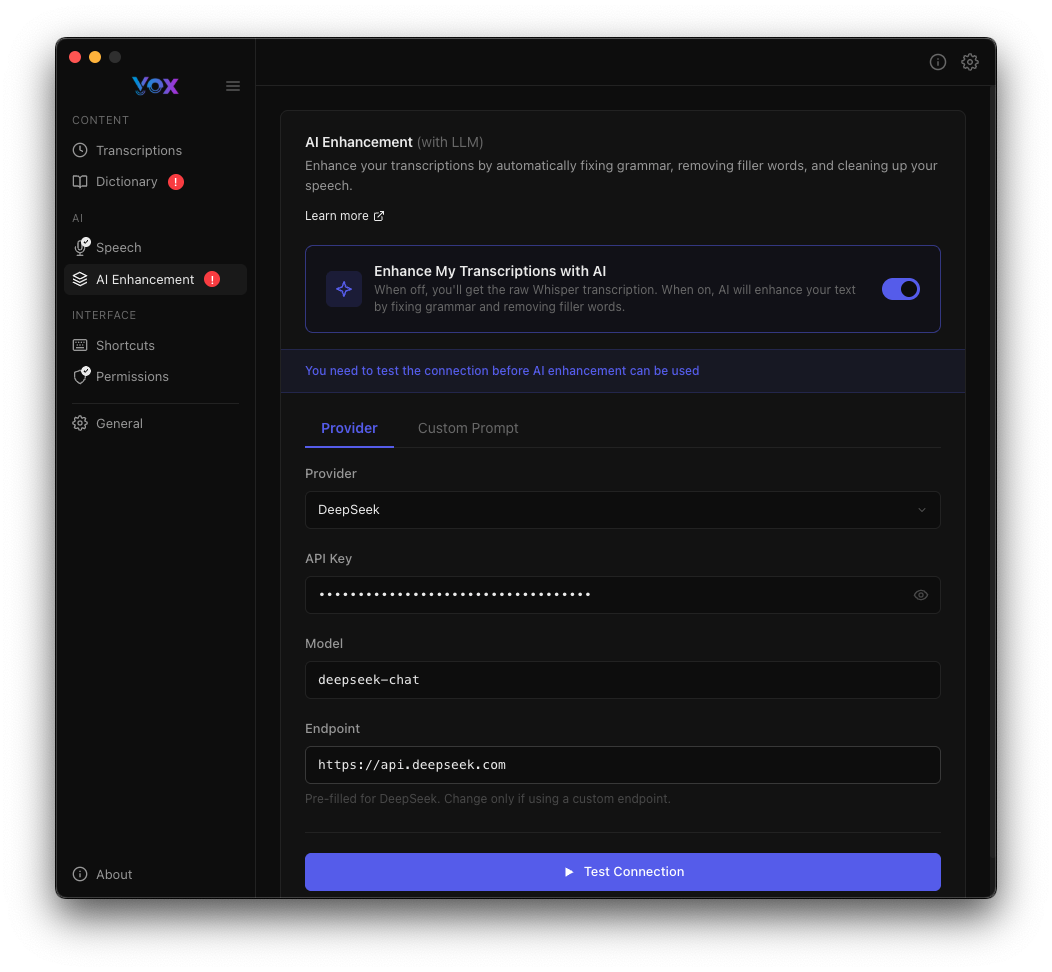

- Clique em Testar Ligação para se certificar de que funciona

Primeira Vez?

Se nunca usou APIs de IA antes, recomendamos começar com OpenAI (ChatGPT). Têm preços claros (€0,002 por pedido) e boa documentação.

Fornecedores Suportados

O Vox suporta múltiplos fornecedores de IA. Clique no menu suspenso Fornecedor para selecionar:

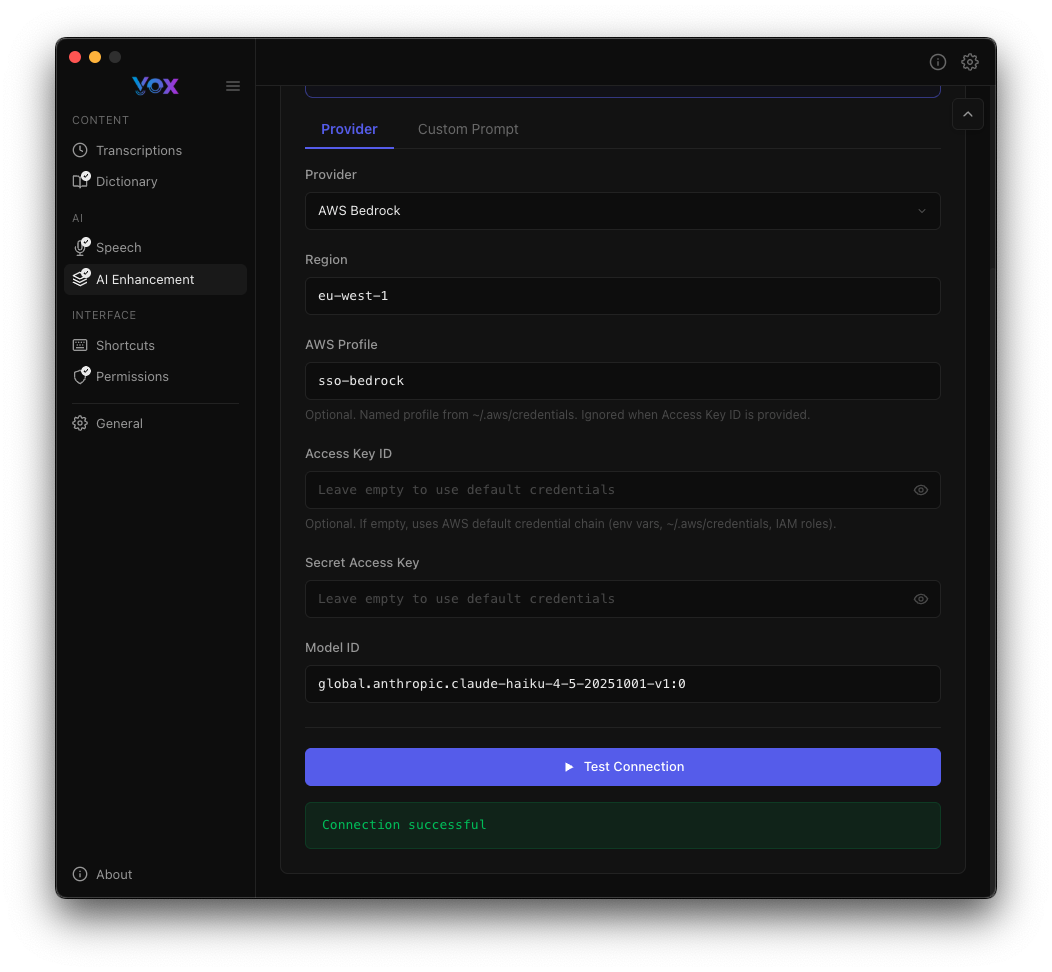

AWS Bedrock

Melhor para: Uso em produção, ambientes empresariais, variedade de modelos

Configuração:

Região

- Selecione a sua região AWS (ex.:

eu-west-1) - Escolha uma região perto de si para menor latência

Perfil AWS

- Introduza o nome do seu perfil AWS (ex.:

sso-bedrock) - Usa credenciais AWS CLI configuradas no seu sistema

ID da Chave de Acesso

- Opcional: Introduza a sua chave de acesso AWS

- Necessário se não usar perfis AWS CLI

- Formato:

AKIA...(20 caracteres)

Chave de Acesso Secreta

- Opcional: Introduza a sua chave de acesso secreta

- Necessário se não usar perfis AWS CLI

- Armazenada de forma segura no Keychain do macOS / Gerenciador de Credenciais do Windows

ID do Modelo

- Especifique o modelo Bedrock a usar

- Exemplo:

global.anthropic.claude-haiku-4-5-20251101-v1:0 - Consulte Modelos AWS Bedrock

Configuração AWS

O AWS Bedrock requer:

- Uma conta AWS com acesso ao Bedrock

- Permissões IAM para o modelo selecionado

- AWS CLI configurado com SSO ou chaves de acesso

DeepSeek

Melhor para: Melhoria de IA económica, bom desempenho

Configuração:

Chave de API

- Obtenha uma chave de API em DeepSeek

- Armazenada de forma segura no Keychain do macOS / Gerenciador de Credenciais do Windows

Modelo

- Especifique o modelo (ex.:

deepseek-chat) - Consulte Documentação da API DeepSeek

Endpoint

- Padrão:

https://api.deepseek.com - Mude apenas se usar um endpoint personalizado

Microsoft Foundry

Melhor para: Utilizadores Azure, integração empresarial

Configuração:

- Semelhante ao AWS Bedrock

- Requer subscrição Azure e acesso ao Foundry

- Usa autenticação Azure

OpenAI

Melhor para: Modelos GPT de alta qualidade, configuração mais simples

Configuração:

- Chave de API: Obtenha em OpenAI Platform

- Modelo:

gpt-4,gpt-4-turbo,gpt-3.5-turbo, etc. - Endpoint: Padrão

https://api.openai.com/v1

GLM (Zhipu AI)

Melhor para: Transcrição em língua chinesa, utilizadores da Ásia-Pacífico

Configuração:

- Chave de API: Obtenha em Zhipu AI

- Modelo:

glm-4,glm-4-air, etc.

Anthropic

Melhor para: Modelos Claude com alta capacidade de raciocínio

Configuração:

- Chave de API: Obtenha em Anthropic Console

- Modelo:

claude-3-5-sonnet-20241022,claude-3-opus-20240229, etc.

LiteLLM

Melhor para: Utilizadores avançados, roteamento de modelos personalizados, API unificada

Configuração:

- Endpoint: URL do seu servidor LiteLLM

- Suporta roteamento para mais de 100 fornecedores LLM

- Consulte Documentação LiteLLM

Testar a Sua Ligação

Após configurar o seu fornecedor:

- Clique em Testar Ligação

- Aguarde a conclusão do teste

- Procure a mensagem "Ligação bem-sucedida!"

Se o teste falhar:

- Verifique se as suas chaves de API/credenciais estão corretas

- Verifique a sua ligação à internet

- Certifique-se de que a sua conta tem acesso ao modelo especificado

- Reveja as mensagens de erro para problemas específicos

Acesso ao Keychain

Pode ser necessário conceder permissão de Keychain para armazenar chaves de API de forma segura.

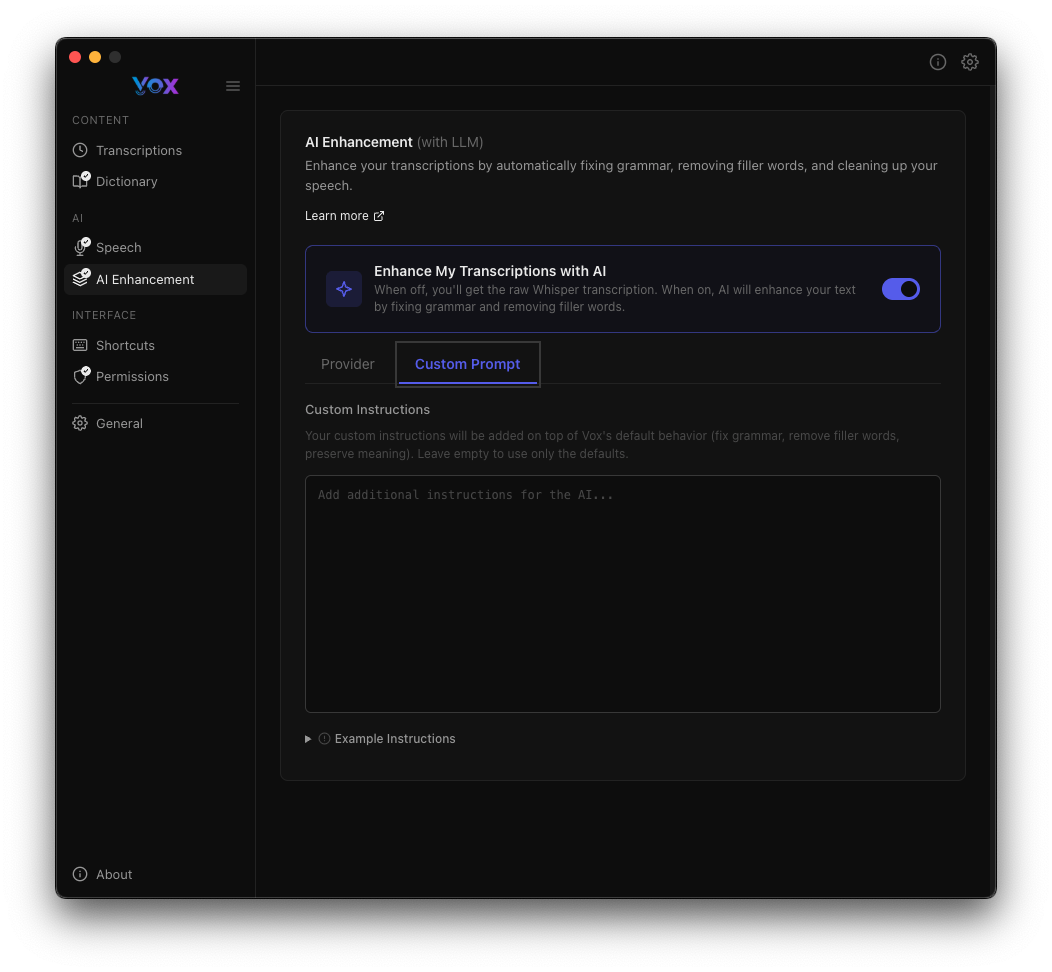

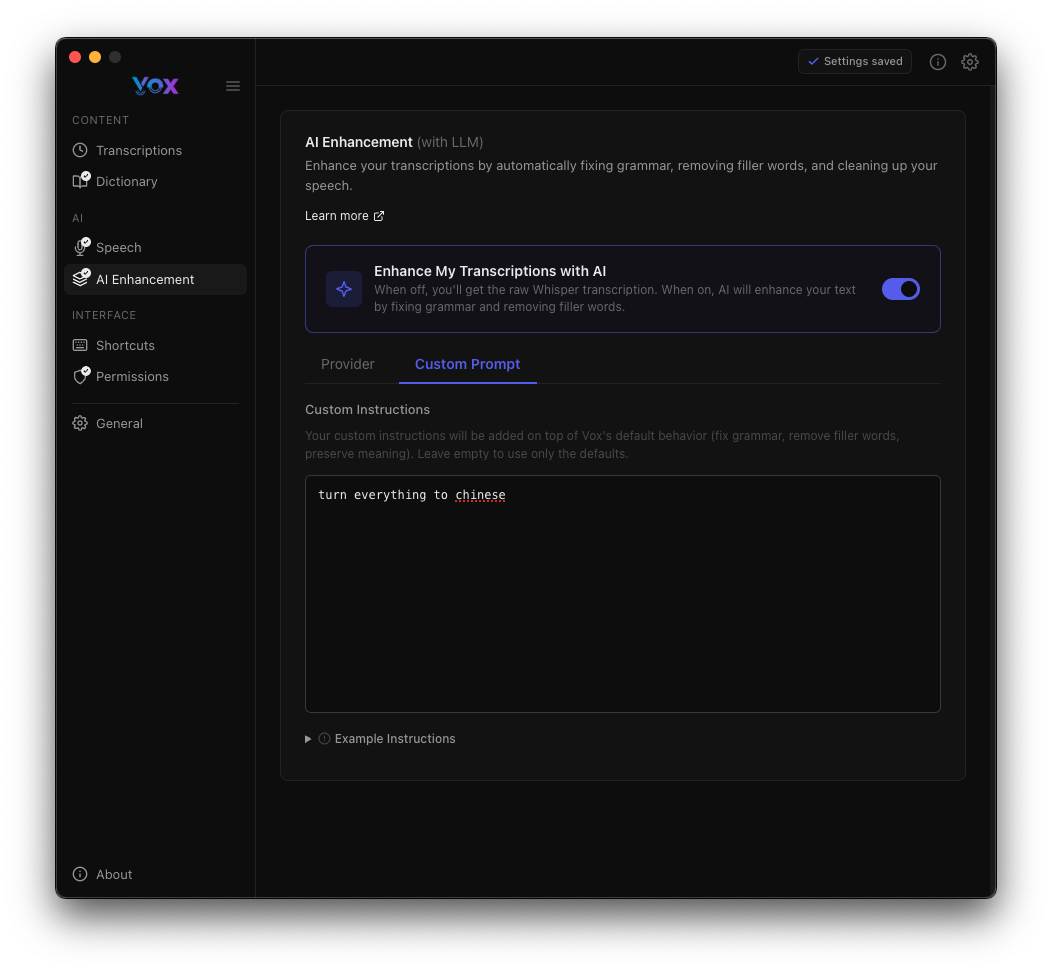

Prompts Personalizados

Personalize como a IA melhora as suas transcrições:

Usar Prompts Personalizados

- Clique no aba Prompt Personalizado

- Introduza as suas instruções personalizadas

- As configurações são guardadas automaticamente

Exemplo de Prompt Personalizado

Exemplo de prompt:

turn everything to chineseIsto vai traduzir todas as transcrições para chinês.

Prompt Padrão

Se não especificar um prompt personalizado, o Vox usa uma instrução padrão para:

- Corrigir gramática e ortografia

- Remover palavras de preenchimento (hmm, é, tipo, etc.)

- Preservar termos técnicos e nomes

- Manter o significado original

Dicas de Prompt

Bons prompts:

- "Corrigir gramática mas manter jargão técnico"

- "Remover palavras de preenchimento e formatar como pontos"

- "Traduzir para espanhol e corrigir gramática"

- "Tornar mais formal e profissional"

Evitar:

- Prompts extremamente longos (podem atingir limites de tokens)

- Prompts que alteram significativamente o significado

- Prompts que adicionam informação não presente na transcrição

Experimente

Teste diferentes prompts com a mesma transcrição para encontrar o que funciona melhor para o seu caso de uso.

Instruções de Exemplo

Exemplo de instruções personalizadas mostradas na interface:

Clique em Instruções de Exemplo para ver prompts de amostra:

- "Adicione instruções adicionais além do comportamento padrão do Vox, como gramática, remover palavras de preenchimento, frases de hesitação"

- Fornece orientação sobre como estruturar as suas instruções personalizadas

Guias Específicos por Fornecedor

Configuração AWS Bedrock

Pré-requisitos:

- Conta AWS com acesso ao Bedrock

- Acesso ao modelo ativado na Consola AWS

- Permissões IAM configuradas

Usando Perfil AWS CLI (Recomendado):

# Configure AWS CLI com SSO

aws configure sso

# Teste o seu perfil

aws bedrock list-foundation-models --profile sso-bedrockNo Vox:

- Selecione o fornecedor AWS Bedrock

- Introduza o nome do perfil (ex.:

sso-bedrock) - Selecione a região

- Introduza o ID do modelo

- Clique em Testar Ligação

Usando Chaves de Acesso:

- Crie chaves de acesso no AWS IAM

- Introduza o ID da Chave de Acesso e a Chave de Acesso Secreta no Vox

- Selecione a região e o modelo

- Clique em Testar Ligação

Segurança

Armazene as chaves de acesso de forma segura. Os perfis AWS CLI com SSO são mais seguros do que chaves de acesso estáticas.

Configuração DeepSeek

Pré-requisitos:

- Conta em platform.deepseek.com

- Chave de API gerada

Configuração:

- Registe-se no DeepSeek

- Gere uma chave de API

- No Vox, selecione o fornecedor DeepSeek

- Introduza a sua chave de API

- Use o modelo

deepseek-chat - Clique em Testar Ligação

Custo: O DeepSeek é económico comparado a outros fornecedores.

Configuração OpenAI

Pré-requisitos:

- Conta OpenAI

- Chave de API com créditos

Configuração:

- Obtenha a chave de API em platform.openai.com/api-keys

- No Vox, selecione o fornecedor OpenAI

- Introduza a sua chave de API

- Escolha o modelo (ex.:

gpt-4-turbo,gpt-3.5-turbo) - Clique em Testar Ligação

Custo: A OpenAI cobra por token. O GPT-4 é mais caro mas de maior qualidade do que o GPT-3.5.

Considerações de Custo

Visão Geral de Preços

Os custos de Melhoria com IA variam por fornecedor:

| Fornecedor | Custo por 1M tokens | Notas |

|---|---|---|

| DeepSeek | ~€0,14 | Mais económico |

| OpenAI GPT-3.5 | ~€0,50 | Bom valor |

| OpenAI GPT-4 | ~€10-30 | Alta qualidade, caro |

| AWS Bedrock | ~€0,25-15 | Varia por modelo |

| Anthropic Claude | ~€3-15 | Alta qualidade |

Estimativa de Custos

Transcrição média: 50-100 tokens Custo por transcrição: €0,001-0,01 (dependendo do fornecedor)

Exemplo de uso:

- 100 transcrições/dia com DeepSeek: ~€0,50/mês

- 100 transcrições/dia com GPT-4: ~€30/mês

Poupar Dinheiro

- Use modelos menores e mais baratos para transcrições simples

- Use GPT-4 ou Claude apenas quando precisar da mais alta qualidade

- O DeepSeek oferece a melhor relação preço-desempenho

Preços Futuros

IA Integrada Em Breve

Atualmente, o Vox usa as suas próprias chaves de API para melhoria com IA. No futuro, podemos oferecer uma opção de modelo de IA integrado pago para maior conveniência.

Isto excluiria a necessidade de gerir chaves de API e potencialmente ofereceria:

- Configuração simplificada (sem chaves de API)

- Preços mensais previsíveis

- Faturação integrada

- Modelos otimizados para transcrição

Fique atento às atualizações!

Melhores Práticas

Quando Usar a Melhoria com IA

Use a Melhoria com IA para:

- E-mails e documentação profissional

- Notas e resumos de reuniões

- Criação de conteúdo e escrita

- Comunicações formais

Ignore a Melhoria com IA para:

- Notas pessoais rápidas

- Quando é necessária privacidade total

- Transcrições simples e curtas

- Quando a velocidade é crítica

Escolher um Fornecedor

Escolha AWS Bedrock se:

- Já usa AWS para outros serviços

- Precisa de segurança de nível empresarial

- Quer acesso a múltiplos fornecedores de modelos

- Tem créditos AWS existentes

Escolha DeepSeek se:

- Quer a opção mais económica

- Precisa de boa qualidade a baixo custo

- Transcreve frequentemente

Escolha OpenAI se:

- Quer a configuração mais simples

- Precisa de resultados fiáveis e de alta qualidade

- Já tem créditos OpenAI

Escolha Anthropic se:

- Precisa de raciocínio avançado e precisão

- Trabalha com conteúdo complexo e técnico

- Quer as capacidades específicas do Claude

Dicas de Engenharia de Prompts

- Seja específico: "Remover palavras de preenchimento e corrigir gramática" é melhor do que "melhorar"

- Teste iterações: Experimente diferentes prompts para encontrar o que funciona

- Combine instruções: "Corrigir gramática, remover preenchimentos e formatar como pontos"

- Considere o contexto: Ajuste prompts para diferentes casos de uso (e-mail vs. comentários de código)

Resolução de Problemas

Falha no Teste de Ligação

AWS Bedrock:

- Verifique se as permissões IAM incluem acesso ao modelo Bedrock

- Confirme que a região corresponde ao local onde o modelo está disponível

- Teste o AWS CLI:

aws bedrock list-foundation-models --region <region> - Certifique-se de que o ID do modelo está correto

DeepSeek/OpenAI/Anthropic:

- Verifique se a chave de API é válida

- Confirme que a sua conta tem créditos/subscrição ativa

- Certifique-se de que o URL do endpoint está correto

- Teste a chave de API com curl:bash

curl https://api.deepseek.com/v1/models \ -H "Authorization: Bearer YOUR_API_KEY"

Melhoria com IA Demora Muito

Soluções:

- Mude para um modelo mais rápido (ex.: GPT-3.5 em vez de GPT-4)

- Use um fornecedor com menor latência

- Verifique a sua ligação à internet

- Reduza a complexidade do prompt personalizado

Texto Melhorado Está Errado

Soluções:

- Ajuste o seu prompt personalizado para ser mais específico

- Experimente um modelo diferente (modelos maiores são frequentemente mais precisos)

- Use um prompt mais simples ou o comportamento padrão

- Verifique primeiro se a sua transcrição base está precisa

Chave de API Armazenada Incorretamente

Solução:

- Navegue para Configurações → Melhoria com IA

- Reintroduza a sua chave de API

- Conceda acesso ao Keychain quando solicitado

- Clique em Testar Ligação para verificar

Custos de API Elevados

Soluções:

- Mude para um fornecedor mais barato (DeepSeek)

- Use a Melhoria com IA seletivamente (desative para notas rápidas)

- Monitorize o uso no painel do seu fornecedor

- Considere usar modelos menores

- Otimize o seu prompt personalizado para reduzir tokens de saída

Segurança e Privacidade

Privacidade de Dados

O que é enviado para fornecedores de IA:

- Apenas transcrição de texto (após processamento local pelo Whisper)

- O seu prompt personalizado

- Sem áudio, sem informação pessoal além do texto da transcrição

O que NÃO é enviado:

- Gravações de áudio originais

- Outras transcrições (cada pedido é independente)

- Informação pessoal das configurações do Vox

Armazenamento Seguro

- Chaves de API: Armazenadas encriptadas no Keychain do macOS / Gerenciador de Credenciais do Windows

- Credenciais: Nunca transmitidas para servidores Vox

- Transcrições: Podem ser retidas localmente (consulte Retenção de Áudio)

Políticas de Privacidade dos Fornecedores

Reveja as políticas de privacidade do fornecedor escolhido:

Processamento de Dados

Quando ativa a Melhoria com IA, as suas transcrições são enviadas para fornecedores de IA terceiros. Se trabalha com informação sensível, considere:

- Usar apenas transcrição local (desativar Melhoria com IA)

- Escolher fornecedores com fortes garantias de privacidade

- Usar implementações privadas (AWS PrivateLink, Azure Private Link)

Configuração Avançada

Endpoints Personalizados

Alguns fornecedores permitem endpoints personalizados para:

- Implementações privadas

- Instalações no local

- Servidores proxy

- Otimizações regionais

Introduza endpoints personalizados no campo Endpoint ao configurar um fornecedor.

LiteLLM para Roteamento Avançado

LiteLLM permite:

- Interface unificada para mais de 100 fornecedores LLM

- Fallback e retry automáticos

- Balanceamento de carga entre múltiplos fornecedores

- Rastreamento de custos e orçamentos

Configuração:

- Implante o servidor LiteLLM: https://docs.litellm.ai

- Selecione o fornecedor LiteLLM no Vox

- Introduza o URL do seu servidor LiteLLM

- Configure o roteamento na configuração LiteLLM

Variáveis de Ambiente

Se usar perfis AWS CLI ou variáveis de ambiente, o Vox respeita:

AWS_PROFILEAWS_REGIONAWS_ACCESS_KEY_IDAWS_SECRET_ACCESS_KEY

Próximos Passos

- Configurar modelos de fala para melhores transcrições base

- Adicionar palavras personalizadas para melhorar a precisão

- Configurar atalhos de teclado para gravação rápida

- Ajustar configurações do HUD para feedback de gravação