Mejora con IA

Función Opcional - ¡Puedes Omitirla!

Este paso es completamente opcional. Vox funciona perfectamente sin la Mejora con IA - tus transcripciones ya serán precisas. Configúrala solo si quieres pulir automáticamente tus transcripciones (corregir gramática, eliminar palabras de relleno como "um" o "eh").

Si no sabes qué es esto o no quieres configurarlo ahora, ¡siéntete libre de pasar a la siguiente sección!

La Mejora con IA usa inteligencia artificial (como ChatGPT o Claude) para limpiar automáticamente tus transcripciones, haciéndolas más pulidas y profesionales.

¿Qué Hace la Mejora con IA?

En términos simples: Toma tu transcripción (que ya es precisa) y la hace sonar más profesional.

Ejemplo:

- Antes de la IA: "Eh, bueno básicamente, como que, necesitamos, este, programar una reunión para, ya sabes, el próximo martes"

- Después de la IA: "Necesitamos programar una reunión para el próximo martes"

Principales Beneficios

- Corrige la gramática: Corrige errores automáticamente

- Elimina palabras de relleno: Se deshace de "um", "eh", "como", etc.

- Lo hace más limpio: Más profesional y fácil de leer

- Mantiene tu significado: Tu mensaje original permanece igual

¿Lo Necesitas?

Puede que quieras la Mejora con IA si:

- Usas Vox para documentos o correos profesionales

- Quieres transcripciones pulidas sin editar

- Te sientes cómodo usando servicios de IA (como ChatGPT)

NO necesitas la Mejora con IA si:

- Solo estás tomando notas rápidas para ti mismo

- Prefieres privacidad completa (la Mejora con IA envía texto a servicios externos)

- No te importa editar transcripciones manualmente

- No sabes qué es una "clave de API"

Nota de Privacidad

Tu audio nunca sale de tu dispositivo. Solo la transcripción de texto se envía al servicio de IA que elijas. Si quieres privacidad completa, deja la Mejora con IA deshabilitada.

Cómo Configurarlo

Requisitos

Para usar la Mejora con IA, necesitas:

- Una cuenta con un servicio de IA (como OpenAI, Anthropic, AWS, etc.)

- Una clave de API (piénsala como una contraseña para el servicio de IA)

- Unos pocos dólares para costos de IA (generalmente $0.01-0.05 por transcripción)

Próximamente: Estamos trabajando en una opción de pago integrada para que no tengas que configurar esto tú mismo.

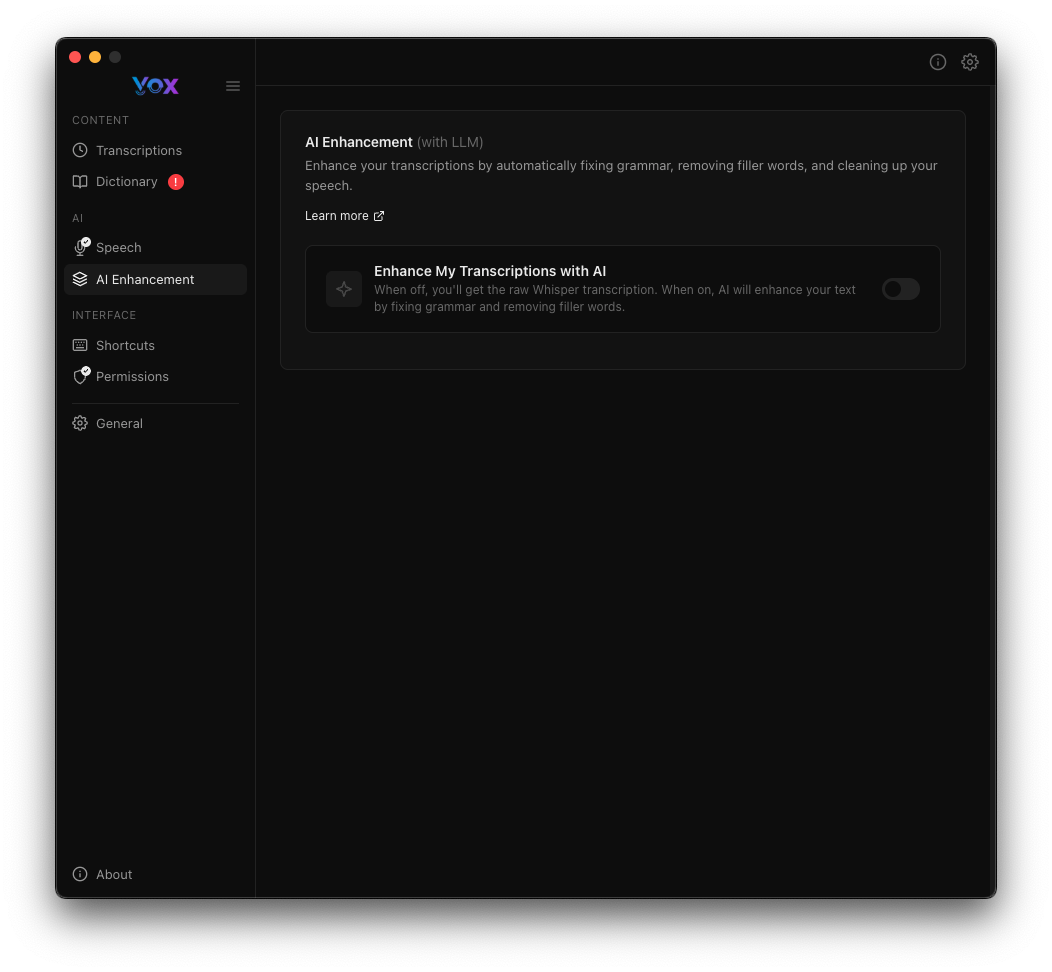

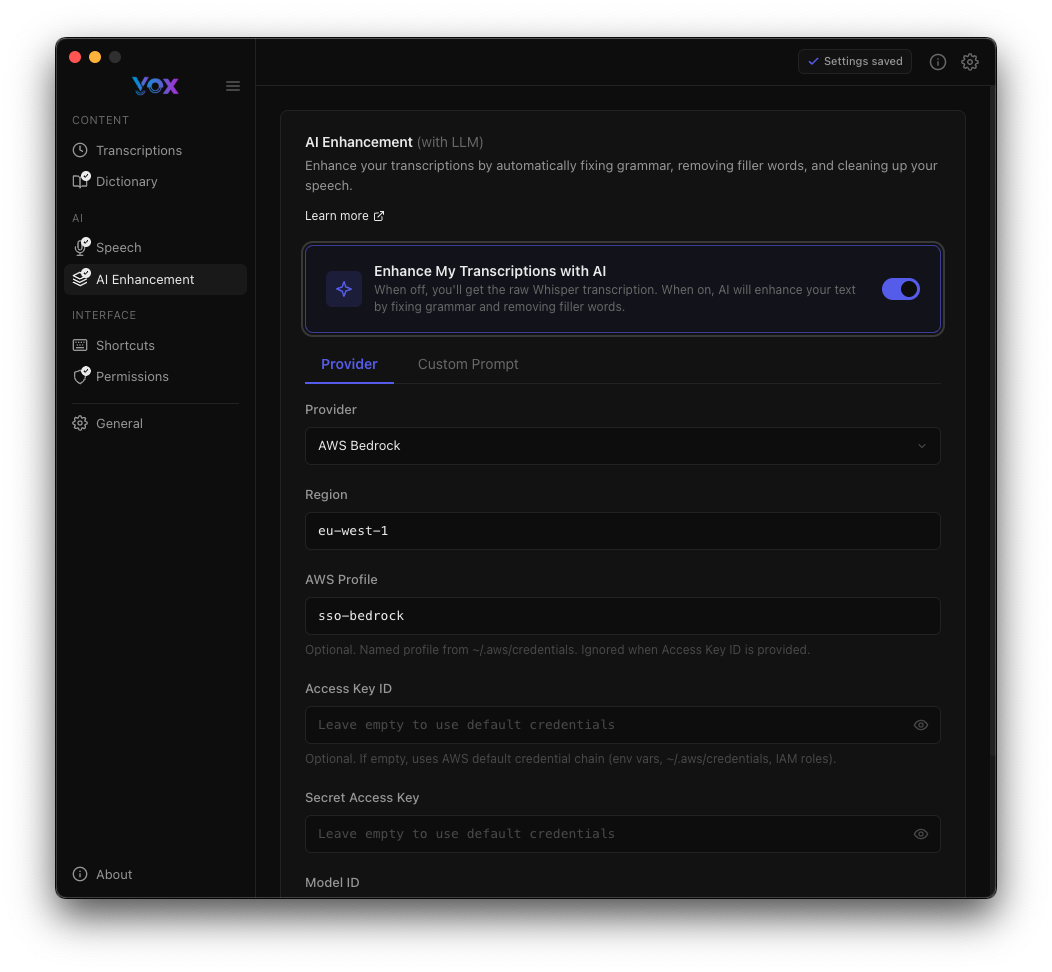

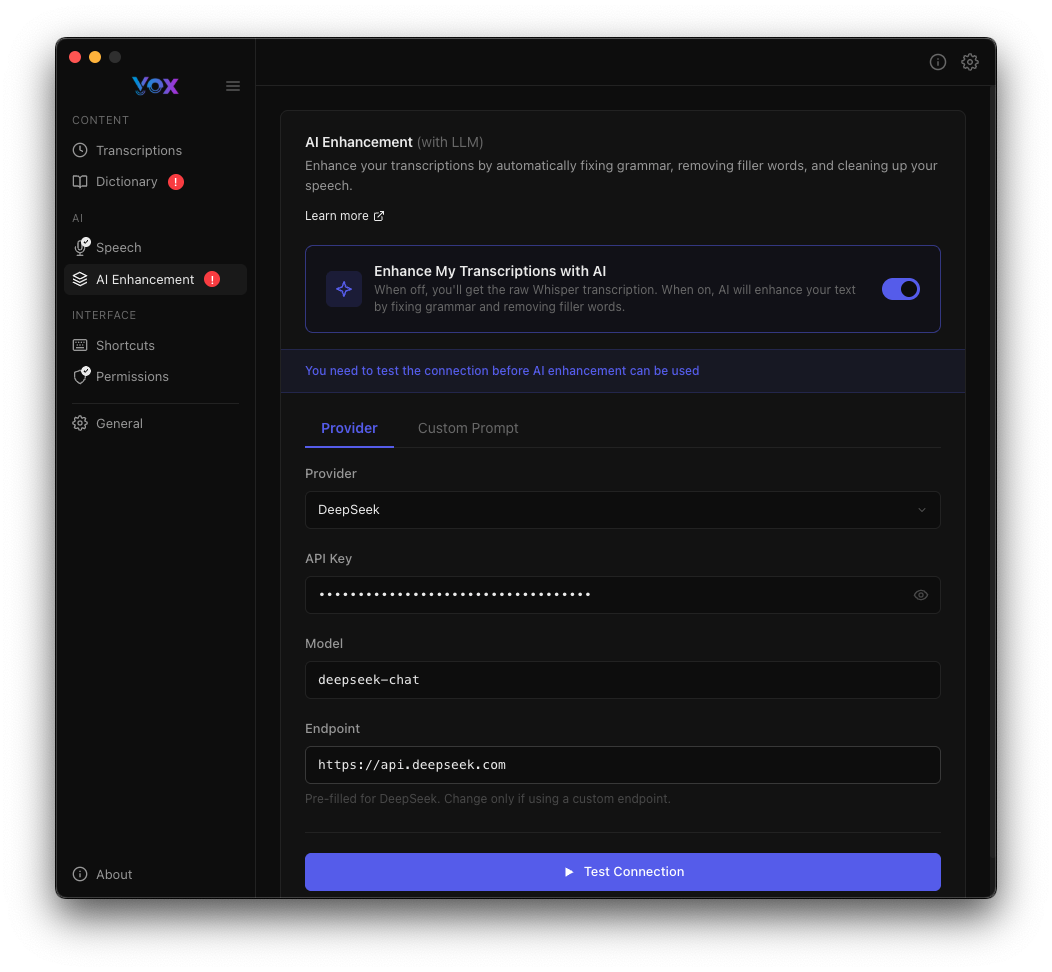

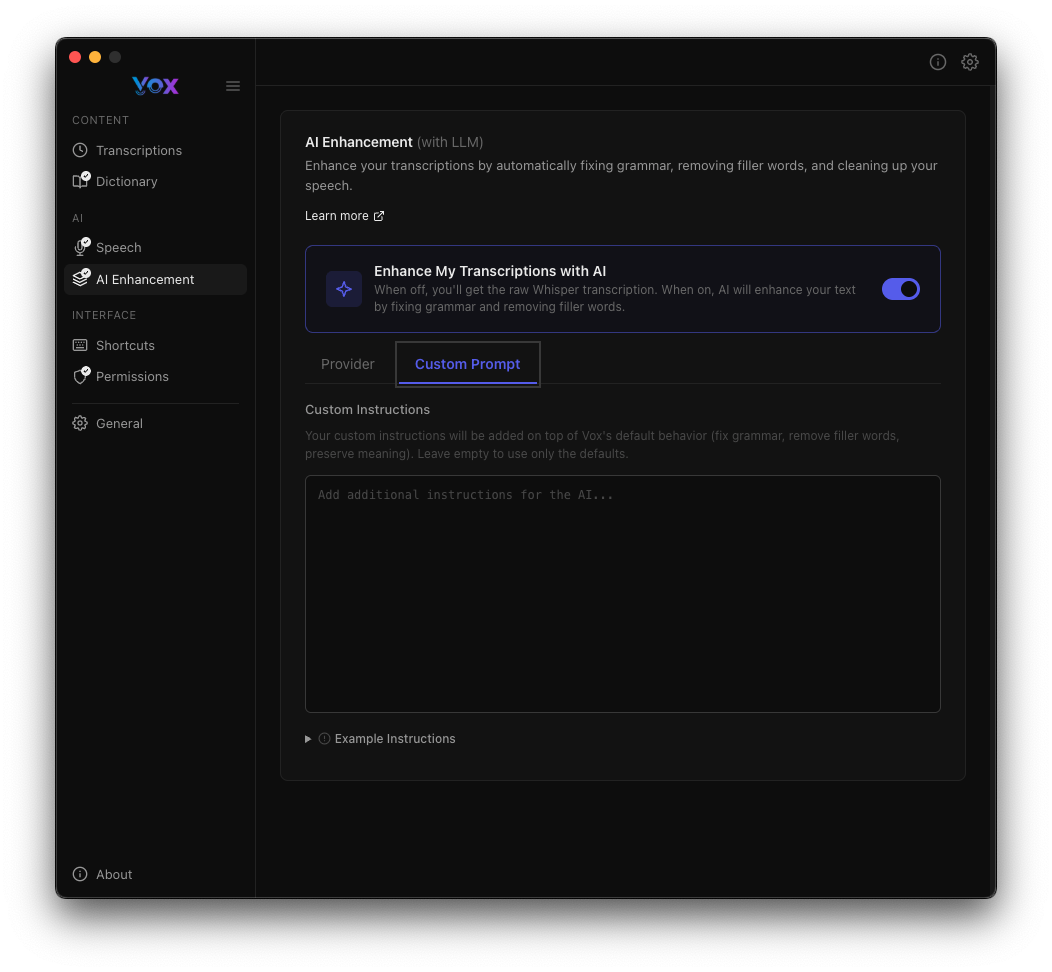

Paso 1: Abrir la Configuración de Mejora con IA

- Abre la configuración de Vox

- Haz clic en Mejora con IA en la barra lateral

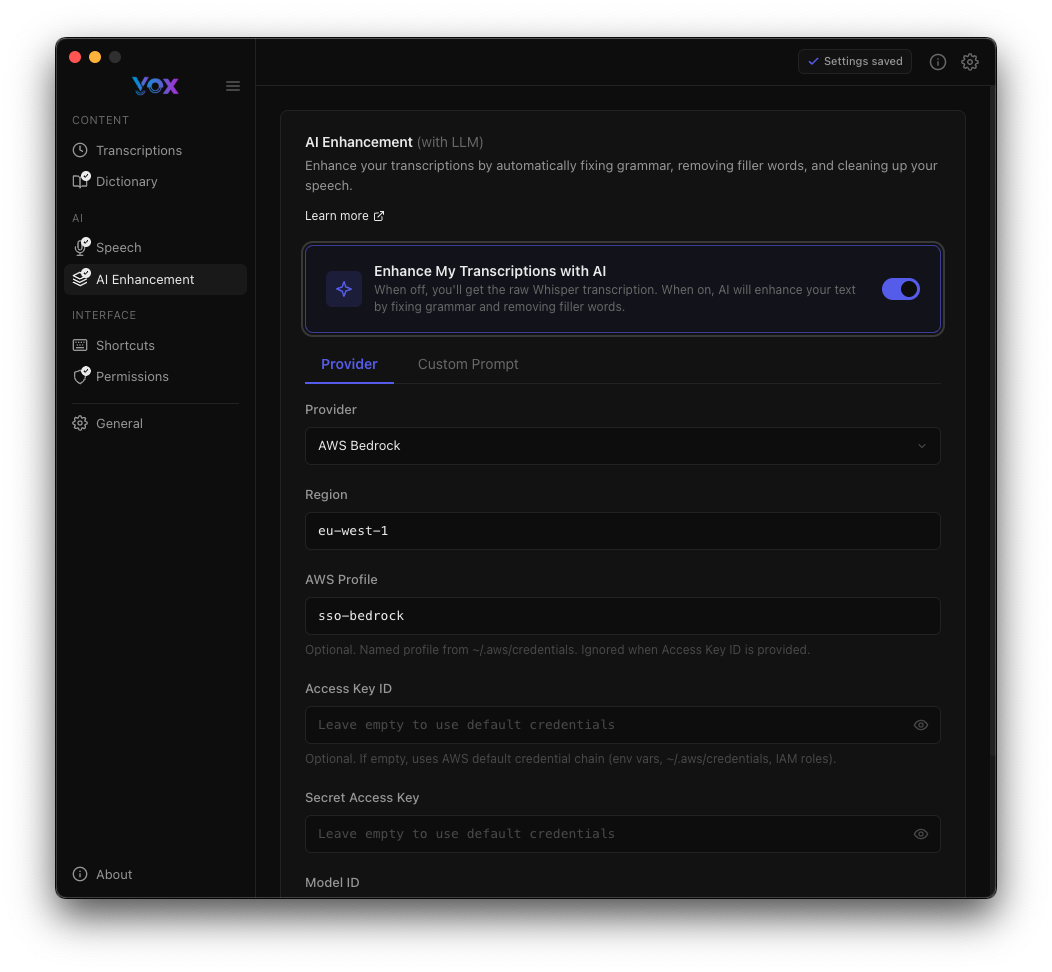

- Activa Mejorar Mis Transcripciones con IA

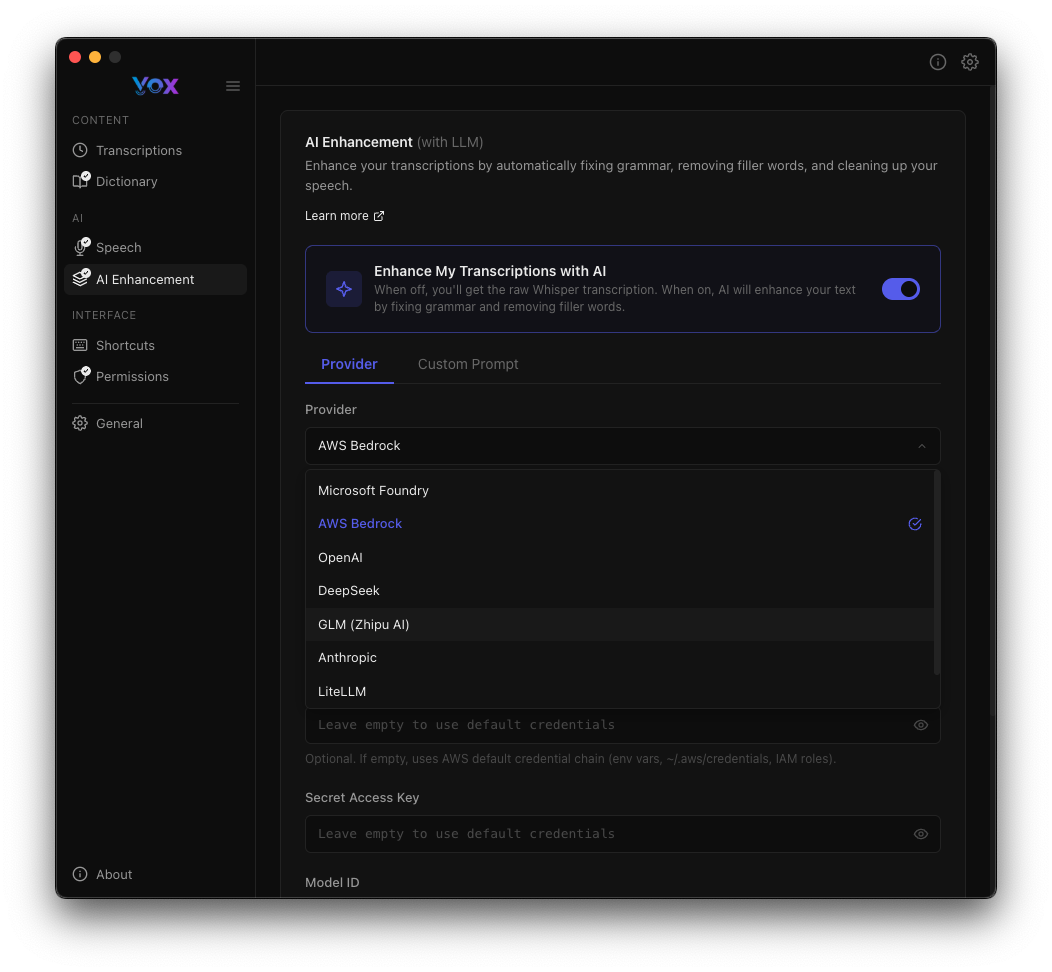

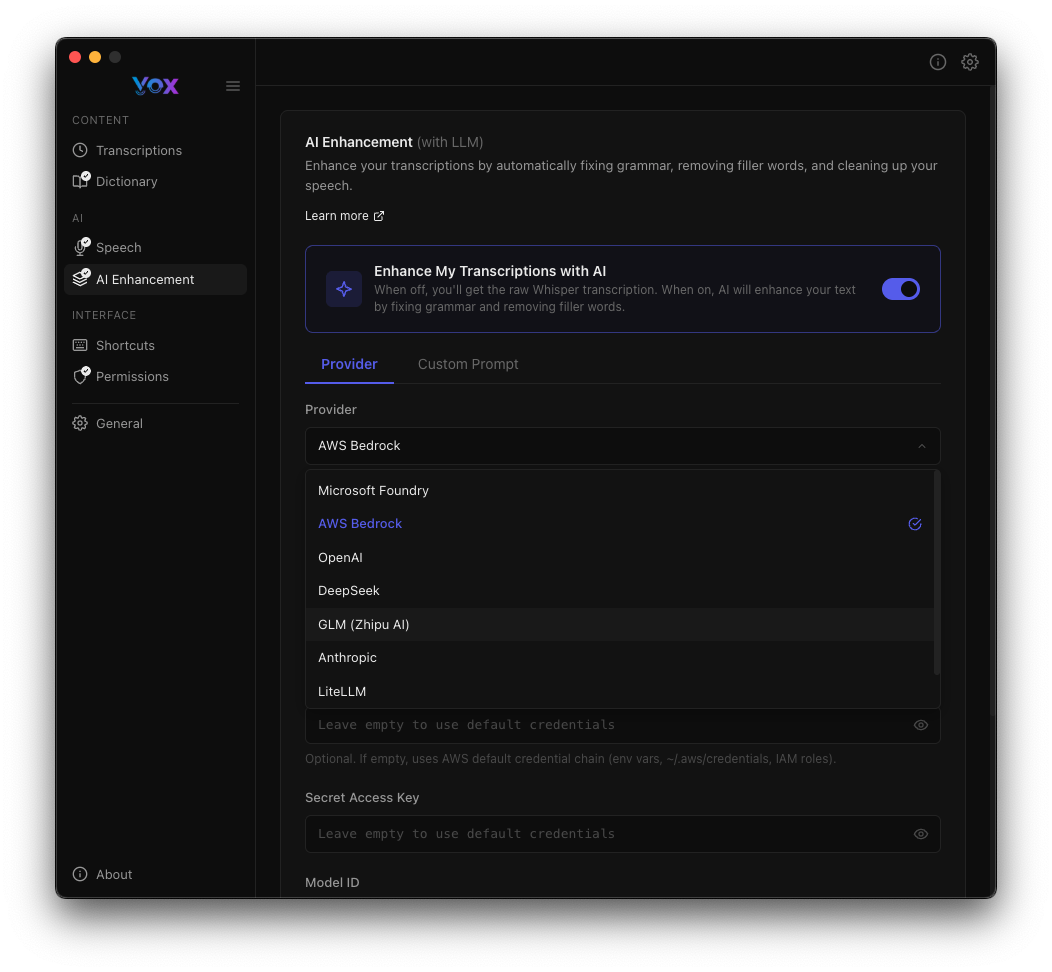

Paso 2: Elegir tu Proveedor de IA

Selecciona un servicio de IA del menú desplegable. Opciones populares:

- OpenAI (ChatGPT) - El más popular, fácil de usar

- Anthropic (Claude) - Buena calidad, enfocado en privacidad

- AWS Bedrock - Para usuarios avanzados

- Ollama - Ejecuta IA localmente (gratis, pero requiere configuración)

Paso 3: Agregar tu Clave de API

- Obtén una clave de API de tu proveedor elegido (ve las secciones de proveedores a continuación)

- Pégala en el campo Clave de API

- Haz clic en Probar Conexión para asegurarte de que funciona

¿Primera Vez?

Si nunca has usado APIs de IA antes, recomendamos empezar con OpenAI (ChatGPT). Tienen precios claros ($0.002 por solicitud) y buena documentación.

Proveedores Compatibles

Vox soporta múltiples proveedores de IA. Haz clic en el menú desplegable Proveedor para seleccionar:

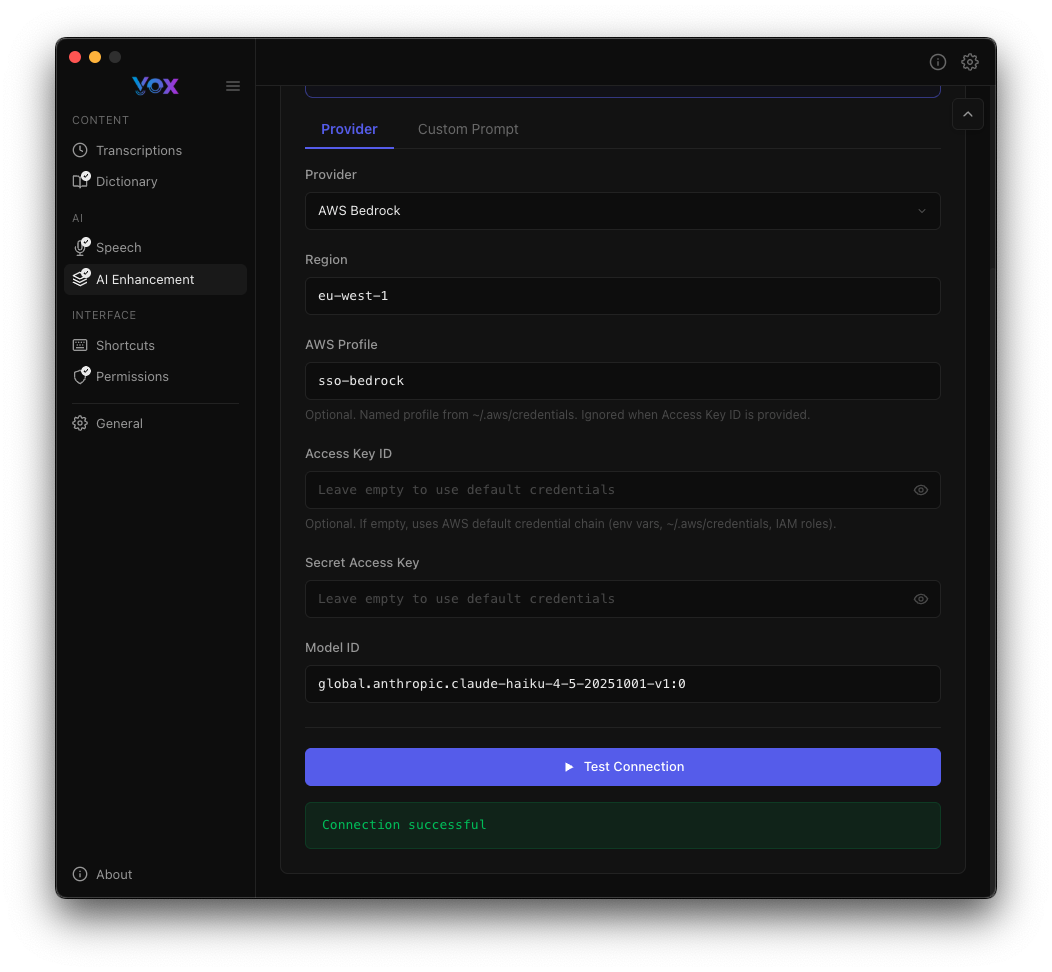

AWS Bedrock

Mejor para: Uso en producción, entornos empresariales, variedad de modelos

Configuración:

Región

- Selecciona tu región de AWS (ej.:

eu-west-1) - Elige una región cercana a ti para menor latencia

Perfil de AWS

- Ingresa el nombre de tu perfil de AWS (ej.:

sso-bedrock) - Usa las credenciales de AWS CLI configuradas en tu sistema

ID de Clave de Acceso

- Opcional: Ingresa tu clave de acceso de AWS

- Requerido si no usas perfiles de AWS CLI

- Formato:

AKIA...(20 caracteres)

Clave de Acceso Secreta

- Opcional: Ingresa tu clave de acceso secreta

- Requerido si no usas perfiles de AWS CLI

- Almacenada de forma segura en el Llavero de macOS / Administrador de Credenciales de Windows

ID de Modelo

- Especifica el modelo de Bedrock a usar

- Ejemplo:

global.anthropic.claude-haiku-4-5-20251101-v1:0 - Ver Modelos de AWS Bedrock

Configuración de AWS

AWS Bedrock requiere:

- Una cuenta de AWS con acceso a Bedrock

- Permisos IAM para el modelo seleccionado

- AWS CLI configurado con SSO o claves de acceso

DeepSeek

Mejor para: Mejora de IA rentable, buen rendimiento

Configuración:

Clave de API

- Obtén una clave de API en DeepSeek

- Almacenada de forma segura en el Llavero de macOS / Administrador de Credenciales de Windows

Modelo

- Especifica el modelo (ej.:

deepseek-chat) - Ver Documentación de API de DeepSeek

Endpoint

- Por defecto:

https://api.deepseek.com - Cambia solo si usas un endpoint personalizado

Microsoft Foundry

Mejor para: Usuarios de Azure, integración empresarial

Configuración:

- Similar a AWS Bedrock

- Requiere suscripción de Azure y acceso a Foundry

- Usa autenticación de Azure

OpenAI

Mejor para: Modelos GPT de alta calidad, configuración más sencilla

Configuración:

- Clave de API: Obtén de OpenAI Platform

- Modelo:

gpt-4,gpt-4-turbo,gpt-3.5-turbo, etc. - Endpoint: Por defecto

https://api.openai.com/v1

GLM (Zhipu AI)

Mejor para: Transcripción en idioma chino, usuarios de Asia-Pacífico

Configuración:

- Clave de API: Obtén de Zhipu AI

- Modelo:

glm-4,glm-4-air, etc.

Anthropic

Mejor para: Modelos Claude con alta capacidad de razonamiento

Configuración:

- Clave de API: Obtén de Anthropic Console

- Modelo:

claude-3-5-sonnet-20241022,claude-3-opus-20240229, etc.

LiteLLM

Mejor para: Usuarios avanzados, enrutamiento de modelos personalizado, API unificada

Configuración:

- Endpoint: URL de tu servidor LiteLLM

- Soporta enrutamiento a más de 100 proveedores LLM

- Ver Documentación de LiteLLM

Probar tu Conexión

Después de configurar tu proveedor:

- Haz clic en Probar Conexión

- Espera a que se complete la prueba

- Busca el mensaje "¡Conexión exitosa!"

Si la prueba falla:

- Verifica que tus claves de API/credenciales sean correctas

- Comprueba tu conexión a internet

- Asegúrate de que tu cuenta tenga acceso al modelo especificado

- Revisa los mensajes de error para problemas específicos

Acceso al Llavero

Es posible que necesites conceder permiso de Llavero para almacenar claves de API de forma segura.

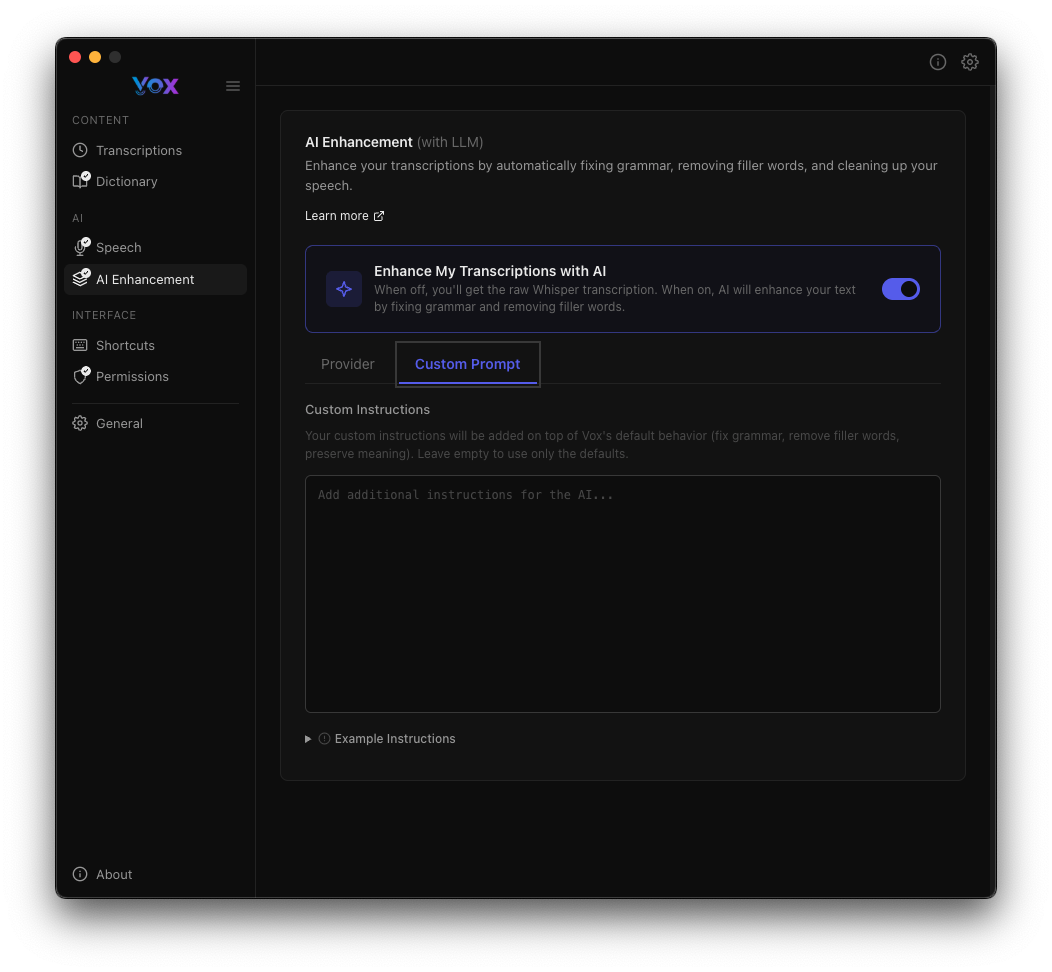

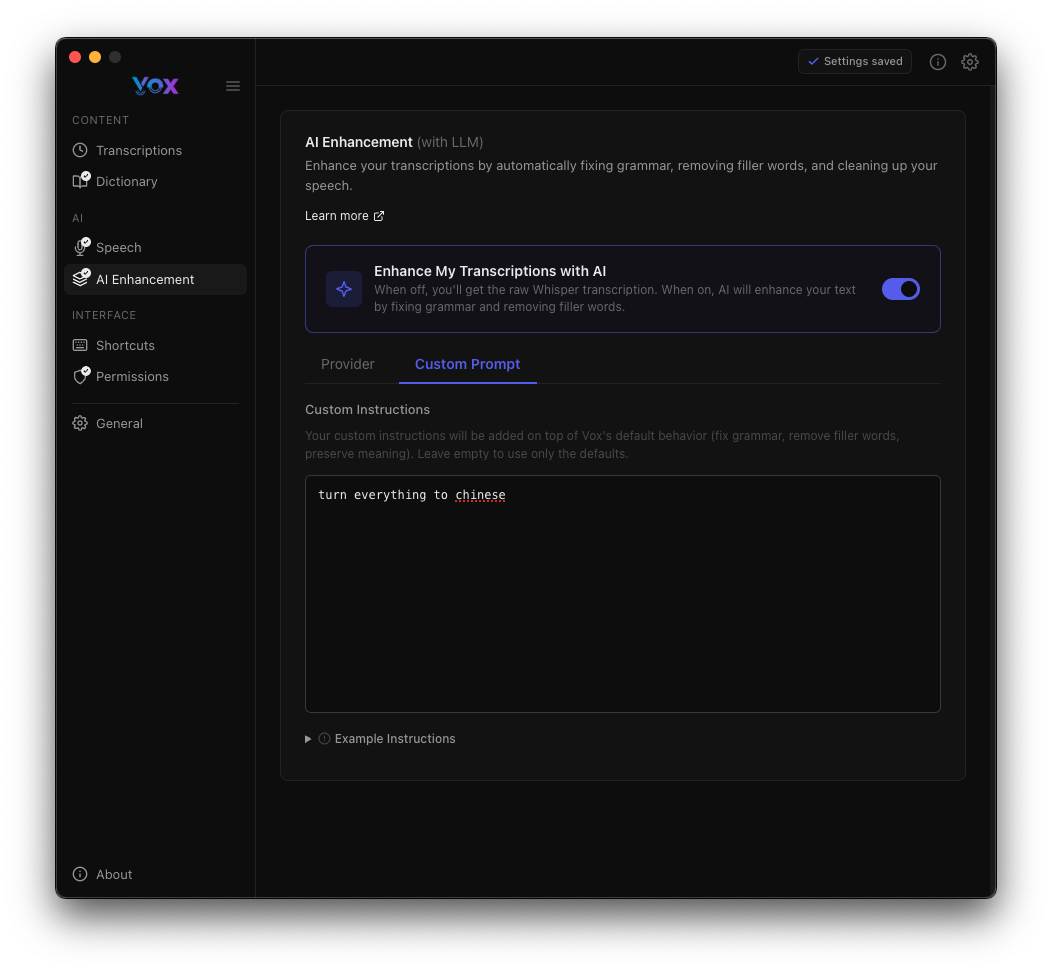

Prompts Personalizados

Personaliza cómo la IA mejora tus transcripciones:

Usar Prompts Personalizados

- Haz clic en la pestaña Prompt Personalizado

- Ingresa tus instrucciones personalizadas

- La configuración se guarda automáticamente

Ejemplo de Prompt Personalizado

Ejemplo de prompt:

turn everything to chineseEsto traducirá todas las transcripciones al chino.

Prompt Predeterminado

Si no especificas un prompt personalizado, Vox usa una instrucción predeterminada para:

- Corregir gramática y ortografía

- Eliminar palabras de relleno (um, eh, como, etc.)

- Preservar términos técnicos y nombres

- Mantener el significado original

Consejos para Prompts

Buenos prompts:

- "Corregir gramática pero mantener jerga técnica"

- "Eliminar palabras de relleno y formatear como puntos"

- "Traducir al español y corregir gramática"

- "Hacer más formal y profesional"

Evitar:

- Prompts extremadamente largos (pueden alcanzar límites de tokens)

- Prompts que cambian el significado significativamente

- Prompts que agregan información no presente en la transcripción

Experimenta

Prueba diferentes prompts con la misma transcripción para encontrar qué funciona mejor para tu caso de uso.

Instrucciones de Ejemplo

Ejemplo de instrucciones personalizadas mostradas en la interfaz:

Haz clic en Instrucciones de Ejemplo para ver prompts de muestra:

- "Agrega instrucciones adicionales además del comportamiento predeterminado de Vox como gramática, eliminar palabras de relleno, frases de duda"

- Proporciona orientación sobre cómo estructurar tus instrucciones personalizadas

Guías Específicas por Proveedor

Configuración de AWS Bedrock

Requisitos previos:

- Cuenta de AWS con acceso a Bedrock

- Acceso al modelo habilitado en la Consola de AWS

- Permisos IAM configurados

Usando Perfil de AWS CLI (Recomendado):

# Configura AWS CLI con SSO

aws configure sso

# Prueba tu perfil

aws bedrock list-foundation-models --profile sso-bedrockEn Vox:

- Selecciona el proveedor AWS Bedrock

- Ingresa el nombre del perfil (ej.:

sso-bedrock) - Selecciona la región

- Ingresa el ID del modelo

- Haz clic en Probar Conexión

Usando Claves de Acceso:

- Crea claves de acceso en AWS IAM

- Ingresa el ID de Clave de Acceso y la Clave de Acceso Secreta en Vox

- Selecciona la región y el modelo

- Haz clic en Probar Conexión

Seguridad

Almacena las claves de acceso de forma segura. Los perfiles de AWS CLI con SSO son más seguros que las claves de acceso estáticas.

Configuración de DeepSeek

Requisitos previos:

- Cuenta en platform.deepseek.com

- Clave de API generada

Configuración:

- Regístrate en DeepSeek

- Genera una clave de API

- En Vox, selecciona el proveedor DeepSeek

- Ingresa tu clave de API

- Usa el modelo

deepseek-chat - Haz clic en Probar Conexión

Costo: DeepSeek es rentable en comparación con otros proveedores.

Configuración de OpenAI

Requisitos previos:

- Cuenta de OpenAI

- Clave de API con créditos

Configuración:

- Obtén la clave de API en platform.openai.com/api-keys

- En Vox, selecciona el proveedor OpenAI

- Ingresa tu clave de API

- Elige el modelo (ej.:

gpt-4-turbo,gpt-3.5-turbo) - Haz clic en Probar Conexión

Costo: OpenAI cobra por token. GPT-4 es más caro pero de mayor calidad que GPT-3.5.

Consideraciones de Costo

Resumen de Precios

Los costos de Mejora con IA varían por proveedor:

| Proveedor | Costo por 1M tokens | Notas |

|---|---|---|

| DeepSeek | ~$0.14 | Más rentable |

| OpenAI GPT-3.5 | ~$0.50 | Buen valor |

| OpenAI GPT-4 | ~$10-30 | Alta calidad, caro |

| AWS Bedrock | ~$0.25-15 | Varía por modelo |

| Anthropic Claude | ~$3-15 | Alta calidad |

Estimación de Costos

Transcripción promedio: 50-100 tokens Costo por transcripción: $0.001-0.01 (dependiendo del proveedor)

Ejemplo de uso:

- 100 transcripciones/día con DeepSeek: ~$0.50/mes

- 100 transcripciones/día con GPT-4: ~$30/mes

Ahorra Dinero

- Usa modelos más pequeños y baratos para transcripciones simples

- Usa GPT-4 o Claude solo cuando necesites la más alta calidad

- DeepSeek ofrece la mejor relación precio-rendimiento

Precios Futuros

IA Integrada Próximamente

Actualmente, Vox usa tus propias claves de API para la mejora con IA. En el futuro, podemos ofrecer una opción de modelo de IA integrado de pago por conveniencia.

Esto eliminaría la necesidad de gestionar claves de API y potencialmente ofrecería:

- Configuración simplificada (sin claves de API)

- Precios mensuales predecibles

- Facturación integrada

- Modelos optimizados para transcripción

¡Mantente atento a las actualizaciones!

Mejores Prácticas

Cuándo Usar la Mejora con IA

Usa la Mejora con IA para:

- Correos electrónicos y documentación profesional

- Notas y resúmenes de reuniones

- Creación de contenido y escritura

- Comunicaciones formales

Omite la Mejora con IA para:

- Notas personales rápidas

- Cuando se requiere privacidad completa

- Transcripciones simples y cortas

- Cuando la velocidad es crítica

Elegir un Proveedor

Elige AWS Bedrock si:

- Ya usas AWS para otros servicios

- Necesitas seguridad de nivel empresarial

- Quieres acceso a múltiples proveedores de modelos

- Tienes créditos de AWS existentes

Elige DeepSeek si:

- Quieres la opción más rentable

- Necesitas buena calidad a bajo costo

- Transcribes frecuentemente

Elige OpenAI si:

- Quieres la configuración más sencilla

- Necesitas resultados confiables y de alta calidad

- Ya tienes créditos de OpenAI

Elige Anthropic si:

- Necesitas razonamiento avanzado y precisión

- Trabajas con contenido complejo y técnico

- Quieres las capacidades específicas de Claude

Consejos de Ingeniería de Prompts

- Sé específico: "Eliminar palabras de relleno y corregir gramática" es mejor que "mejorar"

- Prueba iteraciones: Prueba diferentes prompts para encontrar qué funciona

- Combina instrucciones: "Corregir gramática, eliminar rellenos y formatear como puntos"

- Considera el contexto: Ajusta prompts para diferentes casos de uso (correo vs. comentarios de código)

Solución de Problemas

Falla la Prueba de Conexión

AWS Bedrock:

- Verifica que los permisos IAM incluyan acceso al modelo de Bedrock

- Comprueba que la región coincida con donde está disponible el modelo

- Prueba AWS CLI:

aws bedrock list-foundation-models --region <region> - Asegúrate de que el ID del modelo sea correcto

DeepSeek/OpenAI/Anthropic:

- Verifica que la clave de API sea válida

- Comprueba que tu cuenta tenga créditos/suscripción activa

- Asegúrate de que la URL del endpoint sea correcta

- Prueba la clave de API con curl:bash

curl https://api.deepseek.com/v1/models \ -H "Authorization: Bearer YOUR_API_KEY"

La Mejora con IA Tarda Demasiado

Soluciones:

- Cambia a un modelo más rápido (ej.: GPT-3.5 en vez de GPT-4)

- Usa un proveedor con menor latencia

- Comprueba tu conexión a internet

- Reduce la complejidad del prompt personalizado

El Texto Mejorado Está Incorrecto

Soluciones:

- Ajusta tu prompt personalizado para ser más específico

- Prueba un modelo diferente (los modelos más grandes suelen ser más precisos)

- Usa un prompt más simple o el comportamiento predeterminado

- Verifica primero que tu transcripción base sea precisa

Clave de API Almacenada Incorrectamente

Solución:

- Navega a Configuración → Mejora con IA

- Vuelve a ingresar tu clave de API

- Concede acceso al Llavero cuando se solicite

- Haz clic en Probar Conexión para verificar

Costos de API Altos

Soluciones:

- Cambia a un proveedor más barato (DeepSeek)

- Usa la Mejora con IA selectivamente (desactívala para notas rápidas)

- Monitorea el uso en el panel de tu proveedor

- Considera usar modelos más pequeños

- Optimiza tu prompt personalizado para reducir tokens de salida

Seguridad y Privacidad

Privacidad de Datos

Qué se envía a los proveedores de IA:

- Solo transcripción de texto (después del procesamiento local de Whisper)

- Tu prompt personalizado

- Sin audio, sin información personal más allá del texto de la transcripción

Qué NO se envía:

- Grabaciones de audio originales

- Otras transcripciones (cada solicitud es independiente)

- Información personal de la configuración de Vox

Almacenamiento Seguro

- Claves de API: Almacenadas encriptadas en el Llavero de macOS / Administrador de Credenciales de Windows

- Credenciales: Nunca transmitidas a servidores de Vox

- Transcripciones: Pueden conservarse localmente (ver Retención de Audio)

Políticas de Privacidad de los Proveedores

Revisa las políticas de privacidad de tu proveedor elegido:

Procesamiento de Datos

Cuando habilitas la Mejora con IA, tus transcripciones se envían a proveedores de IA de terceros. Si trabajas con información sensible, considera:

- Usar solo transcripción local (deshabilitar Mejora con IA)

- Elegir proveedores con fuertes garantías de privacidad

- Usar implementaciones privadas (AWS PrivateLink, Azure Private Link)

Configuración Avanzada

Endpoints Personalizados

Algunos proveedores permiten endpoints personalizados para:

- Implementaciones privadas

- Instalaciones locales

- Servidores proxy

- Optimizaciones regionales

Ingresa endpoints personalizados en el campo Endpoint al configurar un proveedor.

LiteLLM para Enrutamiento Avanzado

LiteLLM permite:

- Interfaz unificada para más de 100 proveedores LLM

- Fallback y reintento automáticos

- Balanceo de carga entre múltiples proveedores

- Seguimiento de costos y presupuestos

Configuración:

- Implementa el servidor LiteLLM: https://docs.litellm.ai

- Selecciona el proveedor LiteLLM en Vox

- Ingresa la URL de tu servidor LiteLLM

- Configura el enrutamiento en la configuración de LiteLLM

Variables de Entorno

Si usas perfiles de AWS CLI o variables de entorno, Vox respeta:

AWS_PROFILEAWS_REGIONAWS_ACCESS_KEY_IDAWS_SECRET_ACCESS_KEY

Próximos Pasos

- Configurar modelos de voz para mejores transcripciones base

- Agregar palabras personalizadas para mejorar la precisión

- Configurar atajos de teclado para grabación rápida

- Ajustar la configuración del HUD para retroalimentación de grabación